Auteur: Karl D’haveloose

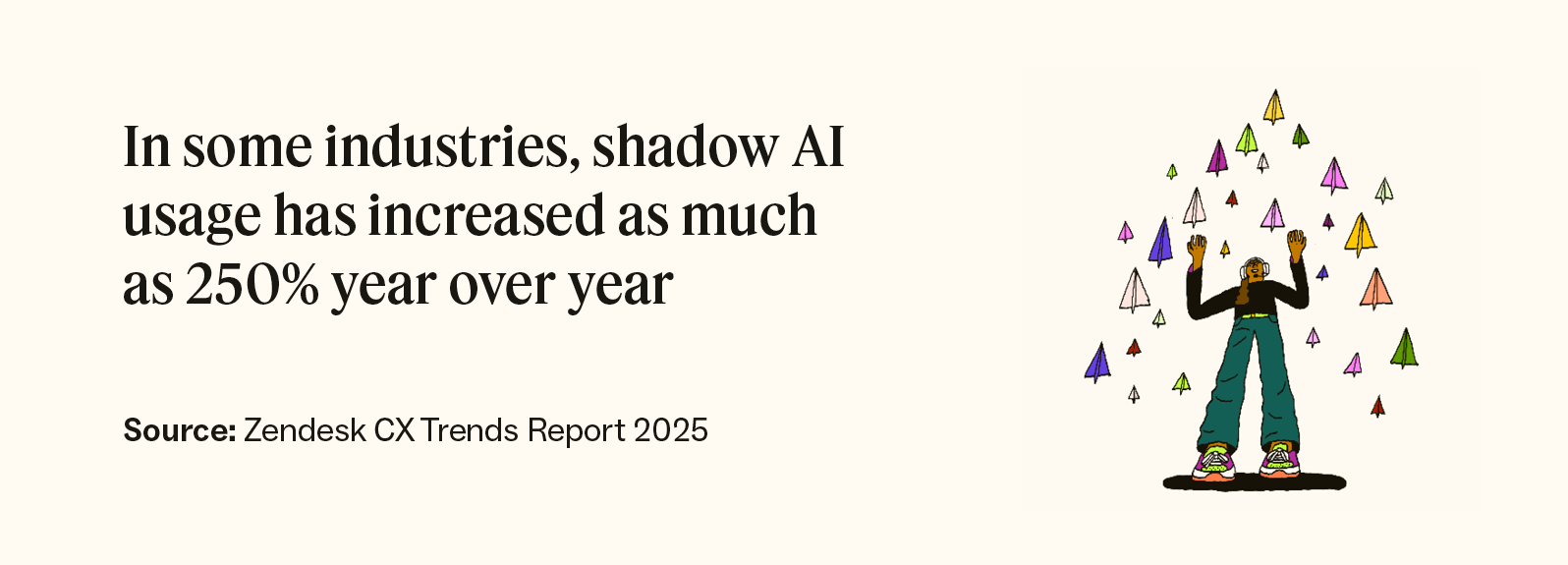

Het kan en moet gezegd worden – zelfs Gemini bekent mits de nodige genuanceerde prompt –dat het grote gevaar van roekeloos AI-gebruik tot op heden niet ingecalculeerd wordt. Pas als het te laat is, gaan we er helaas een cijfer op kunnen plakken. Dus even voor onze ambitieuze en soms onbeteugelde leads binnen productie en engineering & voor C-levels die top down de spelregels liefst vandaag nog grondig moeten communiceren: shadow AI dringt druppelsgewijs, maar systematisch iedere bedrijfsorganisatie binnen. Wat is het, hoe gebeurt het en wat doen we er aan?

Ik nam het artikel van Trends Datanews, namelijk ‘De prijs van gratis: waarom uw personeel de IT-afdeling massaal links laat liggen’ door en diepte even voor eigen interpretatie het onderzoek van Blackfog ( https://www.blackfog.com/blackfog-research-shadow-ai-threat-grows/ ) uit.

De verleiding van freemium en het gemak van de personalisatie

Iedereen kent het principe van freemium en van gratis diensten van de hyperscalers : ‘if you’re not paying for it, then you are the product’. Die these gaat minstens op voor shadow AI, maar de impact is nog extremer. Iedereen kent al de dreiging van shadow IT. Shadow AI dan verwijst naar het ongeautoriseerd gebruik van kunstmatige intelligentie binnen organisaties, zonder goedkeuring, toezicht of governance door de centrale IT- of security-afdeling. Het gaat meestal om werknemers of teams die zelf AI-tools (zoals generatieve AI, taalmodellen en analyticsdiensten) gaan gebruiken buiten de formele goedkeuringskanalen om sneller werk te realiseren, bijvoorbeeld het automatisch schrijven van teksten, analyseren van gegevens of het genereren van codes, zonder dat IT weet welke data er wordt gebruiken of waarvoor.

Het is natuurlijk fancy, als je collega’s kan tonen welke gratis hippe tool je weeral gevonden hebt om die te laten meedraaien in je dagelijkse workflow. Het probleem situeert zich vooral bij het type tools dat werknemers gebruiken. Meer dan de helft (58%) van degenen die niet-goedgekeurde AI-instrumenten inzetten, grijpt naar gratis versies. Vaak gebeurt dit omdat ze sneller zijn of andere functionaliteiten bieden dan de corporate oplossingen. “Er is altijd een kostprijs verbonden aan gratis tools, in dit geval is dat de waarde van je data”, stelt Darren Williams, CEO van BlackFog.

Het ongecontroleerd gebruik van AI-tools of shadow AI kan leiden tot :

Veel lezers uit de industrie moeten het beamen. OT-medewerkers hebben de neiging om uitdagingen enthousiast en pragmatisch aan te pakken, zonder altijd met IT te overleggen of alles wel veilig en compliant is. Waar wordt er meestal geëxperimenteerd. Je ziet dergelijke SAI (shadow AI voor het gemak hier afgekort) verschijnen in de meest gebruikelijke afdelingen.

Ingenieurs willen sneller een PLC-code programmeren, operatoren willen onderhoudsmatig data sneller capteren, aankoop en supply chain willen forecasten, kwaliteit wil defectanalyse automatiseren,… Het begint gefragmenteerd met wat experimentjes met Gemini, Claude, Chat GPT en voor je het weet draaien versies van Github, Code Whisperer of Tabnine in je systeem, die data analyseren, Python-scripts uitvoeren en rapporten schrijven.

Moet het management omarmen of verbieden?

Maar liefst 69% van de topmanagers lijkt weinig problemen te hebben met shadow AI, toont de de studie van Blackfog aan. De beloofde efficiëntiewinsten blijken te verleidelijk. 66% van de ondervraagde directeuren en senior vice-presidents geven prioriteit aan snelheid boven privacy in de race naar AI-adoptie. Volgens Van Belle, CIO van AG Insurance, is de druk om snel te gaan groot, maar weigert hij mee te gaan in een onveilig scenario. “Ik heb het in mijn dertigjarige carrière nog nooit meegemaakt dat ik tegen de business moest zeggen: ‘Wacht misschien zes maanden voor we dit doen’. De kracht van de technologie dwingt ons echter tot voorzichtigheid.” Voor hem is er bij een gereguleerde instelling geen ruimte om ‘een oogje dicht te knijpen’. “Onze Raad van Bestuur zal nooit een policy aanvaarden die de business in gevaar brengt.”

Verwijzend naar ons interview met Wesley Verhoef en Johan Van Campenhout van Agoria: bij OT gaat het over beschikbaarheid, bij IT draait het om confidentialiteit. Laat het nu die beschikbaarheid zijn die ook op het gaspedaal van AI-implementaties duwt.

Als je bronnen zoals Siemens, Rockwell of Microsoft raadpleegt, kom je snel tot volgende statement : “governed AI, not forbidden AI.” Een gecontroleerd compromis mag je stellen. Hoe ga je hier dan te werk? Weet dat als je het volledig verbiedt, er onder de radar verder gewerkt wordt. Met andere woorden het risico op data- en IP-lekken, cyberincidenten en dergelijke groeit.

Voor onschuldige troubleshooting, documentatie en research mag je bijvoorbeeld op standaard gratis alternatieven. Zodra er met klantendata, recepturen of CAD-files wordt gewerkt, is dit strikt verboden.

Conclusie: in een Industry 4.0-wereld, waar fout-& rootcodes analyseren, het snel debuggen van plc-codes of downtime- en procesanalyse van competitief belang is, kan je niet anders dan AI officieel omarmen en integreren. Voorzie budget en ga te raad bij specialisten.